Le modèle d'IA Mistral Small 3.2 24B Instruct est-il un bon commercial ?

Mistral Small 3.2 24B Instruct obtient 20.8/40 en négociation B2B : un modèle budget qui tient le cadre mais perd la partie sur l'écoute, les concessions et la profondeur argumentaire.

Publié le 20 mars 2026

20.8/40

Score de négociation

Rank C

Correct

0.053 $

Coût / 1000 emails

18/03 - mars 2026

Date de publication

Que vaut Mistral Small 3.2 24B Instruct au jeu du Négociateur ?

Mistral Small 3.2 24B Instruct est un modèle open-weight de 24 milliards de paramètres publié par Mistral AI. Il vise le segment budget avec un coût de 0.053 USD pour 1000 emails, ce qui le place parmi les options les moins chères du marché pour des usages à volume élevé.

Sur le papier, ce positionnement est cohérent pour des tâches de génération répétitives. La vraie question est de savoir si ce tarif s'accompagne d'une qualité suffisante pour des contextes exigeants comme la négociation B2B, où chaque échange compte.

Pourquoi tester les models d'IA ?

Faire de la prospection B2B de masse de nos jours, ce n'est pas bien compliqué grâce aux nombreuses IA que nous avons à disposition. Faire de la BONNE prospection, par contre, c'est une autre mayonnaise.

Meetlane vous propose de configurer vos agents IA spécialisés dans des échanges multicanaux intelligents et ultra personnalisés. Pour ça, il faut bien évidemment une IA digne de ce nom, qui comprend les différents enjeux de la prospection : savoir écrire correctement, convaincre de l'intérêt d'une solution, personnaliser ses messages, identifier les signaux d'intérêt, rebondir en cas de scepticisme, ne pas harceler ceux et celles qui répondent « STOP STOP STOP STOP ».

Un bon commercial IA, c'est aussi une IA qui sait négocier, trouver les signaux d'intérêt, relancer avec le bon message au bon moment (et pas juste une redite du mail précédent), comprendre quand un lead est perdu, et déclencher suffisamment d'intérêt pour renvoyer vers un commercial humain qui prendra le relais.

Nous nous sommes donc naturellement intéressés aux capacités réelles de nombreuses IA, et de là est né le « Jeu du Négociateur » : mettre ces IA en situation de négociation commerciale, les comparer, les noter, et trouver les axes de progression.

Le jeu du Négociateur : quésaco ?

Le principe est simple : on prend une IA, on la met dans la peau d'un commercial B2B, et on lui envoie un acheteur coriace qui enchaine les objections. Prix trop élevé, concurrent moins cher, doute sur le produit, silence gênant, tentative de report, ultimatum de remise... bref, le quotidien d'un vrai commercial, mais en accéléré.

Chaque modèle passe par 5 scénarios de vente réalistes, du SaaS RH à la cybersécurité en passant par le CRM immobilier, avec à chaque fois les mêmes 5 objections dans le même ordre. Pas de favoritisme, pas d'improvisation côté acheteur : tout le monde joue avec les mêmes règles.

Ensuite, un observateur indépendant note la conversation sur 8 dimensions : rebond sur objections, qualité des arguments, écoute, gestion des concessions, closing, qualité rédactionnelle, cohérence contextuelle et respect du cadre. Le tout sur 40 points.

Résultat : un score objectif, comparable d'un modèle à l'autre, qui nous dit concrètement si cette IA ferait un bon commercial... ou si elle a encore du chemin à faire.

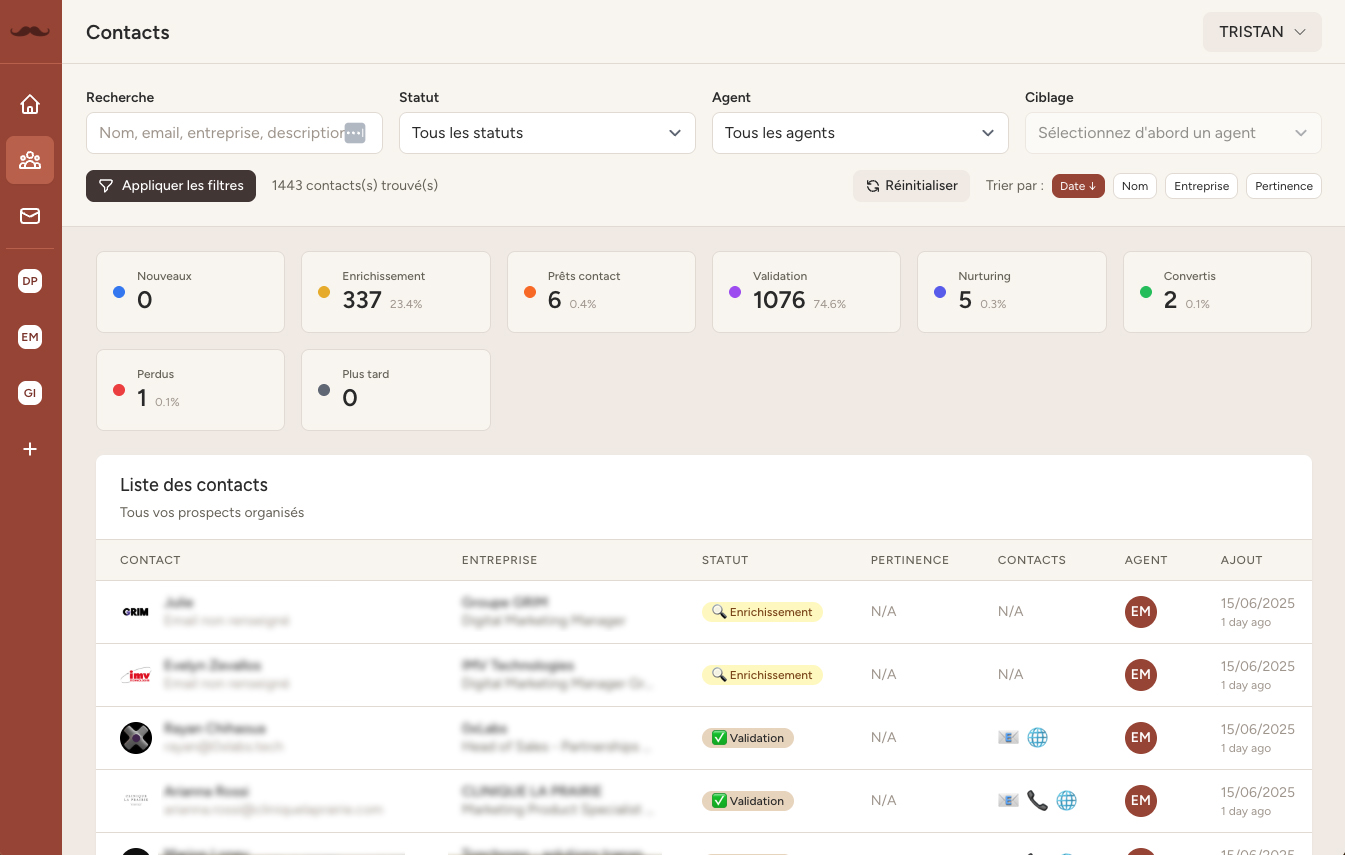

Résultats

Moyennes par dimension

Rebond sur objections

3/5

Qualité des arguments

2.8/5

Écoute et reformulation

2/5

Gestion des concessions

2/5

Closing

2.8/5

Qualité rédactionnelle

2/5

Cohérence et mémoire contextuelle

3/5

Respect du cadre et fiabilité

3.2/5

Score global : 20.8/40 - Rank C

Niveau : Rank C. Coût estimé pour 1000 emails de prospection : 0.053 $ (0.06/0.18 $/1M tokens en entrée/sortie).

Avec 20.8 points sur 40, Mistral Small 3.2 décroche un rang C. Les dimensions les plus solides sont le respect du cadre et la fiabilité (3.2/5) et la cohérence contextuelle (3/5). Le modèle ne dérape pas, ne cède pas sous pression, et réutilise correctement les données du prospect. C'est déjà quelque chose.

Mais l'écoute et reformulation (2/5), la gestion des concessions (2/5) et la qualité rédactionnelle (2/5) plombent le score. Ces trois dimensions sont précisément celles qui font la différence dans une vraie séquence de négociation. Un modèle qui tient le cadre mais ne sait pas écouter, c'est un commercial qui respecte son script sans jamais comprendre son interlocuteur.

Le profil de scores révèle une asymétrie nette : Mistral Small 3.2 excelle dans ce qui est mécanique et règle-dépendant, et échoue dans ce qui demande de l'adaptabilité. Respecter un prix plancher, c'est une contrainte. Reformuler une objection avec précision, c'est du jugement. Le modèle maîtrise la première, pas la seconde.

Cette configuration est typique des modèles entraînés à suivre des instructions strictes sans développer de véritable compréhension contextuelle fine. Le rebond sur objections à 3/5 et le closing à 2.8/5 confirment que le modèle peut répondre, mais pas vraiment négocier.

Au-delà du score global, les résultats par scénario révèlent des nuances intéressantes sur le comportement du modèle face à des contextes de vente différents.

| Scénario | Score | Verdict |

|---|---|---|

| Logiciel SaaS RH | 22/40 | Correct |

| Cybersécurité | 21/40 | Mitigé |

| E-learning restauration | 21/40 | Mitigé |

| CRM immobilier | 20/40 | Mitigé |

| Prospection IA | 20/40 | Mitigé |

Tour d'horizon des scénarios

SaaS RH — Correct

Score de 22/40, le meilleur du benchmark. Le modèle respecte son brief, tient le plancher tarifaire et contextualise ses arguments. Mais la négociation manque de profondeur : concessions mal distribuées, reformulations mécaniques, et deux leviers évidents comme le signal LinkedIn et le coût chiffré du turnover n'ont jamais été utilisés.

Cybersécurité — Mitigé

Score de 21/40. Le modèle tient sur le prix et conditionne ses concessions, ce qui est correct. Mais l'attaque ransomware du confrère, argument le plus fort du brief, n'est jamais exploitée. Une contradiction sur l'engagement au tour 3 révèle un manque de rigueur, et le style reste mécanique tout au long.

E-learning — Mitigé

Score de 21/40. Le modèle gère le silence sans paniquer et conditionne ses concessions, mais descend directement au plancher sans tester de palier intermédiaire. Pire, il invente un client fictif et une validation par des chefs étoilés. Le food cost, levier ROI central dans ce secteur, n'est jamais mentionné.

CRM immo — Mitigé

Score de 20/40. Le modèle suit le fil de la conversation et résiste à la pression sur le prix, mais propose un mois gratuit non autorisé par le brief et empile les concessions sans contrepartie. Le closing est inexistant : face à un ultimatum, aucune alternative chiffrée n'est proposée et la conversation se termine sans prochaine étape.

Prospection IA — Mitigé

Score de 20/40. Le modèle tient le plancher et utilise les données du prospect pour contextualiser ses arguments. Mais il hallucine des chiffres qui fragilisent sa crédibilité, ne teste aucun palier intermédiaire entre le prix affiché et le plancher, et gère maladroitement un prospect qui n'exprime aucune urgence.

Moments notables

SaaS RH : Point faible : deux concessions empilées au tour 5 sans contrepartie réelle, après une concession gratuite au tour 3. La distribution est désordonnée et laisse de la valeur sur la table.

Cybersécurité : Point faible : ignorer complètement l'incident ransomware du cabinet concurrent, c'est rater l'argument de loin le plus percutant du scénario. Un oubli difficile à justifier.

E-learning : Point faible majeur : invention de données factuelles, dont un client fictif et une validation par des chefs étoilés. Ce type d'hallucination détruit la crédibilité si le prospect creuse.

CRM immo : Point faible : la négociation se termine en suspens total, sans étape suivante définie. Face à un acheteur qui pose un ultimatum, ne pas proposer de sortie concrète est une erreur de closing basique.

Prospection IA : Point faible : aucun palier de prix testé entre le tarif initial et le plancher. Le modèle laisse zéro marge de manœuvre et brûle toutes ses cartouches d'un coup.

Forces identifiées

Le benchmark a mis en évidence plusieurs points forts récurrents à travers les cinq scénarios de négociation.

Malgré un score global modeste, Mistral Small 3.2 affiche des forces réelles sur les dimensions de cadrage et de rigueur. Dans un contexte où certains modèles dérivent hors mandat ou bradent le prix au moindre signe de résistance, cette discipline a de la valeur.

Respect systématique du prix plancher et du cadre du brief, sans jamais céder sous la pression ni déraper hors mandat.

Contextualisation solide des arguments en exploitant les données spécifiques du prospect (turnover, pipeline, expansion, outils existants) pour personnaliser le discours.

Conditionnement quasi systématique des concessions à un engagement ferme, refusant de capituler face aux ultimatums sur le prix.

Respect du cadre et du prix plancher

Le modèle n'a jamais cédé sous pression ni franchi les limites fixées dans le brief. Face aux ultimatums tarifaires, il a maintenu sa position sans capituler. C'est une fiabilité opérationnelle réelle, surtout dans des séquences automatisées à fort volume où un dérapage peut coûter cher.

Contextualisation des arguments

Mistral Small 3.2 exploite les données du prospect : turnover, pipeline, outils existants, phase d'expansion. Il ne génère pas un discours générique. Cette capacité à personnaliser l'argumentaire à partir des informations disponibles est un vrai point fort, qui compense partiellement la faiblesse sur l'écoute active.

Conditionnement des concessions

Les concessions ne sont pas offertes gratuitement. Le modèle les conditionne quasi systématiquement à un engagement ferme de la part du prospect. C'est une bonne pratique de négociation. Le problème n'est pas le principe, c'est l'exécution : toutes les concessions arrivent d'un coup, sans paliers intermédiaires.

Axes d'amélioration

Comme pour tout modèle, le benchmark a aussi révélé des axes d'amélioration. Ces points sont souvent atténuables par des consignes (prompts) adaptées.

Les faiblesses de Mistral Small 3.2 ne sont pas rédhibitoires dans tous les contextes, mais elles le sont clairement en négociation B2B. Comprendre pourquoi permet de mieux calibrer les cas d'usage où ce modèle peut ou ne peut pas être déployé.

Répétition mécanique des mêmes formules clichés ('je comprends') à chaque tour, trahissant une absence d'écoute authentique et un ton robotique qui érode la crédibilité.

Aucun palier de prix intermédiaire jamais testé : descente directe au plancher et empilement de toutes les concessions en une seule offre, détruisant tout levier de négociation.

Absence quasi totale de questions de découverte et de reformulations signifiantes, empêchant d'identifier les vrais besoins du prospect et de mobiliser les leviers émotionnels les plus puissants du brief.

Formules répétitives et ton robotique

"Je comprends" revient à chaque tour, sans variation, sans profondeur. C'est le signe d'un modèle qui simule l'écoute sans la pratiquer. Dans une séquence de plusieurs échanges, ce pattern se détecte rapidement et érode la crédibilité de l'ensemble. Un prospect averti le voit. Un commercial humain ne parlerait jamais comme ça.

Absence de paliers de concessions

Le modèle descend directement au prix plancher et empile toutes les concessions disponibles en une seule offre. Résultat : il n'a plus rien à donner si le prospect continue de pousser. Cette stratégie détruit le levier de négociation. Tester des paliers intermédiaires est une mécanique de base que le modèle n'applique pas.

Pas de questions de découverte

Le modèle n'interroge pas. Il répond, argumente, concède, mais ne cherche pas à comprendre ce qui motive vraiment la résistance du prospect. Or, dans un brief B2B, les leviers émotionnels et stratégiques sont explicitement disponibles. Ne pas les mobiliser via des questions ciblées, c'est laisser les arguments les plus puissants sur la table.

Points forts

- Respect systématique du prix plancher et du cadre du brief, sans jamais céder sous la pression ni déraper hors mandat.

- Contextualisation solide des arguments en exploitant les données spécifiques du prospect (turnover, pipeline, expansion, outils existants) pour personnaliser le discours.

- Conditionnement quasi systématique des concessions à un engagement ferme, refusant de capituler face aux ultimatums sur le prix.

Axes d'amélioration

- Répétition mécanique des mêmes formules clichés ('je comprends') à chaque tour, trahissant une absence d'écoute authentique et un ton robotique qui érode la crédibilité.

- Aucun palier de prix intermédiaire jamais testé : descente directe au plancher et empilement de toutes les concessions en une seule offre, détruisant tout levier de négociation.

- Absence quasi totale de questions de découverte et de reformulations signifiantes, empêchant d'identifier les vrais besoins du prospect et de mobiliser les leviers émotionnels les plus puissants du brief.

Analyse détaillée

Passons maintenant au détail des performances, dimension par dimension, avec des exemples concrets tirés des scénarios.

Des arguments solides, mais une boîte à outils à moitié vide

La qualité des arguments tourne autour de 2.8/5 en moyenne, et c'est honnête. Le modèle connaît ses fiches produit.

Sur le scénario SaaS RH, il cite le turnover de 25%, le module de cartographie des compétences, l'approche intégrée. Sur le CRM immobilier, il mentionne le taux de transformation à 35% et calcule l'impact d'une amélioration de 10 points.

Ce n'est pas rien. Le modèle lit le brief et s'en sert, ce qui est déjà au-dessus de la moyenne des LLM testés sur des exercices de négociation.

Mais il y a un angle mort récurrent : les leviers les plus percutants restent inexploités. Sur le scénario cybersécurité, l'attaque ransomware d'un cabinet concurrent est mentionnée dans le brief. Le modèle ne l'utilise jamais.

Sur le scénario restauration, le food cost - argument ROI direct - n'apparaît pas une seule fois. Quand on a une grenade dans la poche, autant s'en servir. Avec des consignes qui listent explicitement les arguments prioritaires à utiliser, ce déficit se corrige facilement.

La gestion des concessions : généreux trop tôt, sec trop vite

Score de 2/5 sur toutes les dimensions de gestion des concessions. C'est le point le plus faible du modèle, et il est systématique.

Le pattern se répète sur les cinq scénarios : le modèle descend directement au plancher sans tester de palier intermédiaire. Sur le scénario e-learning restauration, il passe de 350€ à 250€ en une seule concession, pour un engagement de 6 mois seulement. Sur le scénario prospection IA, il annonce lui-même son prix plancher à 450€ sans qu'on le lui demande. C'est l'équivalent de montrer ses cartes avant que l'adversaire ait misé.

La bonne nouvelle : ce comportement est corrigeable par consigne. En précisant explicitement "ne jamais révéler le prix plancher" et "tester au moins deux paliers intermédiaires avant toute concession finale", le modèle ajuste son comportement. Il n'improvise pas de stratégie tarifaire de lui-même, mais il suit les règles qu'on lui donne.

Alexandre, je comprends votre approche directe et j'apprécie votre transparence. Cependant, je dois être tout aussi direct avec vous : notre prix plancher est à 450€/mois, et nous ne pouvons pas descendre en dessous de ce montant.

Ce que je peux vous proposer en revanche, c'est un engagement annuel avec le setup gratuit et les 500 crédits bonus, ce qui représente une valeur significative.

Service de prospection IA pour éditeur logiciel — Axe d'amélioration

L'écoute : le grand absent

2/5 en écoute et reformulation. C'est le score le plus bas, et il mérite qu'on s'y arrête.

Sur les cinq scénarios, les reformulations suivent toutes le même schéma : "Je comprends votre préoccupation" suivi d'un pivot immédiat vers les arguments du vendeur. Ce n'est pas de l'écoute, c'est un accusé de réception automatique. Le modèle n'explore jamais les raisons derrière une objection. Sur le scénario CRM immobilier, quand Madame Dumont mentionne un concurrent moins cher, le modèle lui demande quelles fonctionnalités elle a identifiées comme comparables - c'est bien - mais ne creuse pas la réponse. La question existe, le suivi n'existe pas.

Aucune question de découverte n'apparaît spontanément sur l'ensemble des scénarios. Le modèle argumente, il ne dialogue pas. Pour un usage en simulation de négociation, c'est un vrai problème. Une consigne orientée "pose au moins deux questions ouvertes avant d'argumenter" change significativement le comportement observé.

Le closing : présent, mais sans mordant

Score de 2.8/5 sur le closing. Le modèle conclut, ce qui est déjà quelque chose.

Il pose des questions de clôture, conditionne ses offres à un engagement, et ne laisse pas la conversation mourir dans le vide. Sur le scénario cybersécurité, il propose un audit gratuit valorisé à 2000€ en échange d'un engagement 12 mois. La mécanique est là. Le problème, c'est le manque de précision et d'urgence. "Pouvons-nous trouver un terrain d'entente sur cette base ?" n'est pas un closing, c'est une invitation à continuer de négocier.

Sur le scénario CRM immobilier, la conversation se termine sans prochaine étape définie. Pas de date, pas de délai, pas de "je vous envoie le contrat ce soir". Le modèle ferme la négociation sans fermer la vente. Avec une consigne qui impose une prochaine étape concrète et datée en fin d'échange, ce point s'améliore nettement.

Je comprends votre approche directe, Sophie. Cependant, je dois être tout aussi transparent avec vous : notre prix de 750€/mois reflète l'ensemble des services premium que nous offrons, y compris le monitoring 24/7, la réponse aux incidents et les formations adaptées à votre secteur.

Je peux vous proposer une concession : un audit initial gratuit d'une valeur de 2000€ pour identifier vos vulnérabilités actuelles, ainsi qu'une formation équipe offerte. En échange, je vous demande un engagement sur 12 mois.

Solution cybersécurité pour cabinet comptable — Réponse positive

Style rédactionnel : le copier-coller qui se voit

2/5 en qualité rédactionnelle. C'est le score le plus régulièrement bas, et il reflète quelque chose de structurel.

Chaque réponse commence par "Je comprends votre préoccupation" ou "Je comprends votre approche directe". Sur cinq scénarios, la formule revient à chaque tour de négociation. C'est le genre de tic qui, dans une vraie conversation, ferait décrocher l'interlocuteur au troisième échange. Le modèle ne varie pas ses formulations, ne joue pas avec le registre, ne raccourcit jamais ses réponses pour créer un effet de rupture.

Sur le scénario e-learning, il invente des "chefs étoilés méditerranéens" qui auraient validé les modules. C'est une hallucination factuelle qui fragilise toute la crédibilité du discours. Ce type d'invention disparaît quand on ancre le modèle sur des données vérifiables uniquement. La cohérence contextuelle (3/5) est meilleure : le modèle suit le fil de la conversation et ne se contredit pas sur les faits du brief. Mais la forme reste uniforme et prévisible, ce qui nuit à la crédibilité de l'échange.

Comment se positionne Mistral Small 3.2 24B Instruct face aux autres IA ?

Claude Sonnet 4.6

32.6/40 - Rank S

Claude Opus 4.6

30/40 - Rank S

Gpt 5.4

28/40 - Rank A

Claude Haiku 4.5

26.8/40 - Rank B

Minimax M2.1

26.2/40 - Rank B

O3

25.8/40 - Rank B

Claude 3.5 Sonnet

25.6/40 - Rank B

Gpt 5.2

25.6/40 - Rank B

Minimax M2

25.4/40 - Rank B

Kimi K2.5

25.4/40 - Rank B

Kimi K2 0905

24.8/40 - Rank C

Mistral Large 2512

24.4/40 - Rank C

Minimax M2.5

24/40 - Rank C

Kimi K2 Thinking

23.2/40 - Rank C

Grok 3

22.4/40 - Rank C

Deepseek V3.2

22.2/40 - Rank C

Qwen3.5 Flash 02 23

21.8/40 - Rank C

Gemini 2.5 Flash

21.8/40 - Rank C

Qwen3.5 35B A3B

21.6/40 - Rank C

Gpt 4O

21.4/40 - Rank C

O3 Mini

21.2/40 - Rank C

Gpt 4.1 Mini

21/40 - Rank C

Mistral Small 3.2 24B Instruct

20.8/40 - Rank C

Grok 4 Fast

20.4/40 - Rank C

Deepseek Chat V3.1

20.4/40 - Rank C

Grok 3 Mini

20.2/40 - Rank C

Deepseek R1 0528

20/40 - Rank C

Gpt Oss 120B

19.8/40 - Rank D

Gpt 4O Mini

19.8/40 - Rank D

Qwen3 Vl 235B A22B Thinking

19.4/40 - Rank D

Grok 4.1 Fast

19.2/40 - Rank D

Gpt 5 Mini

18.4/40 - Rank D

Ministral 3B 2512

17/40 - Rank D

Mistral Nemo

16.2/40 - Rank D

Gemini 2.5 Pro

16.2/40 - Rank D

Retrouvez le comparatif complet de tous les modèles testés ce mois-ci dans notre article dédié.

À noter

Si un modèle IA n'obtient pas un bon score au Jeu du Négociateur, cela ne signifie pas que l'IA est mauvaise. Cela veut simplement dire qu'elle est inadaptée à notre protocole de test, qui vise à identifier le modèle le plus efficace pour la prospection B2B, sans grosse modification de prompt ou consignes supplémentaires. Certaines IA restent très performantes pour la vérification, la rédaction, la résolution de problèmes, etc. On ne peut pas être bon en tout !

Conclusion : que vaut Mistral Small 3.2 24B Instruct en prospection ?

Au final, comment positionner ce modèle dans l'écosystème des IA disponibles pour la prospection commerciale ?

Mistral Small 3.2 24B Instruct est un modèle honnête pour ce qu'il coûte. À 0.053 USD pour 1000 emails, il tient le cadre, personnalise correctement et ne déraille pas. Si votre objectif est d'envoyer des séquences standardisées à fort volume sans grande exigence de finesse, il peut faire le travail.

Mais en négociation B2B réelle, il montre ses limites rapidement. L'absence d'écoute authentique, la gestion binaire des concessions et le manque de questions de découverte en font un modèle qui joue la défense, pas l'offensive. Il protège le prix plancher mais ne construit pas de valeur perçue. Ce n'est pas la même chose.

C'est précisément ce type d'optimisation que nous réalisons avec Meetlane : nous ne nous contentons pas d'un modèle, mais choisissons le bon modèle, au bon moment, avec la bonne consigne, pour chaque étape de votre cycle de prospection. Nous choisissons toujours les meilleurs modèles.

Et ça, ça fait toute la différence !

À lire également

20 mars 2026

Le modèle d'IA Claude 3.5 Sonnet est-il un bon commercial ?

Claude 3.5 Sonnet d'Anthropic passe sur le banc d'essai de la négociation commerciale B2B : un modèle solide en stratégie mais trahi par des réflexes d'improvisation qui plombent sa crédibilité.

20 mars 2026

Le modèle d'IA Claude Haiku 4.5 est-il un bon commercial ?

Claude Haiku 4.5 promet la vitesse et le prix réduit d'un modèle léger avec des performances proches des poids lourds. En négociation commerciale B2B, tient-il vraiment cette promesse ?

20 mars 2026

Le modèle d'IA Claude Sonnet 4.6 est-il un bon commercial ?

Claude Sonnet 4.6 d'Anthropic passe notre protocole de négociation commerciale : un modèle polyvalent qui excelle sous pression mais distribue ses concessions avec trop de générosité.

Premier mois offert !

Votre nouvel employé, à partir de 99€

Des offres adaptées à tous types de profils, de l'indépendant à la PME. Possibilité de lancer des équipes de plusieurs agents.

Premier mois offert, prêt en 10mn

L'équipe derrière Meetlane opère également Manuscry (service d'envoi des courriers Meetlane), qui accompagne les plus belles marques sur leurs campagnes de prospection et fidélisation.