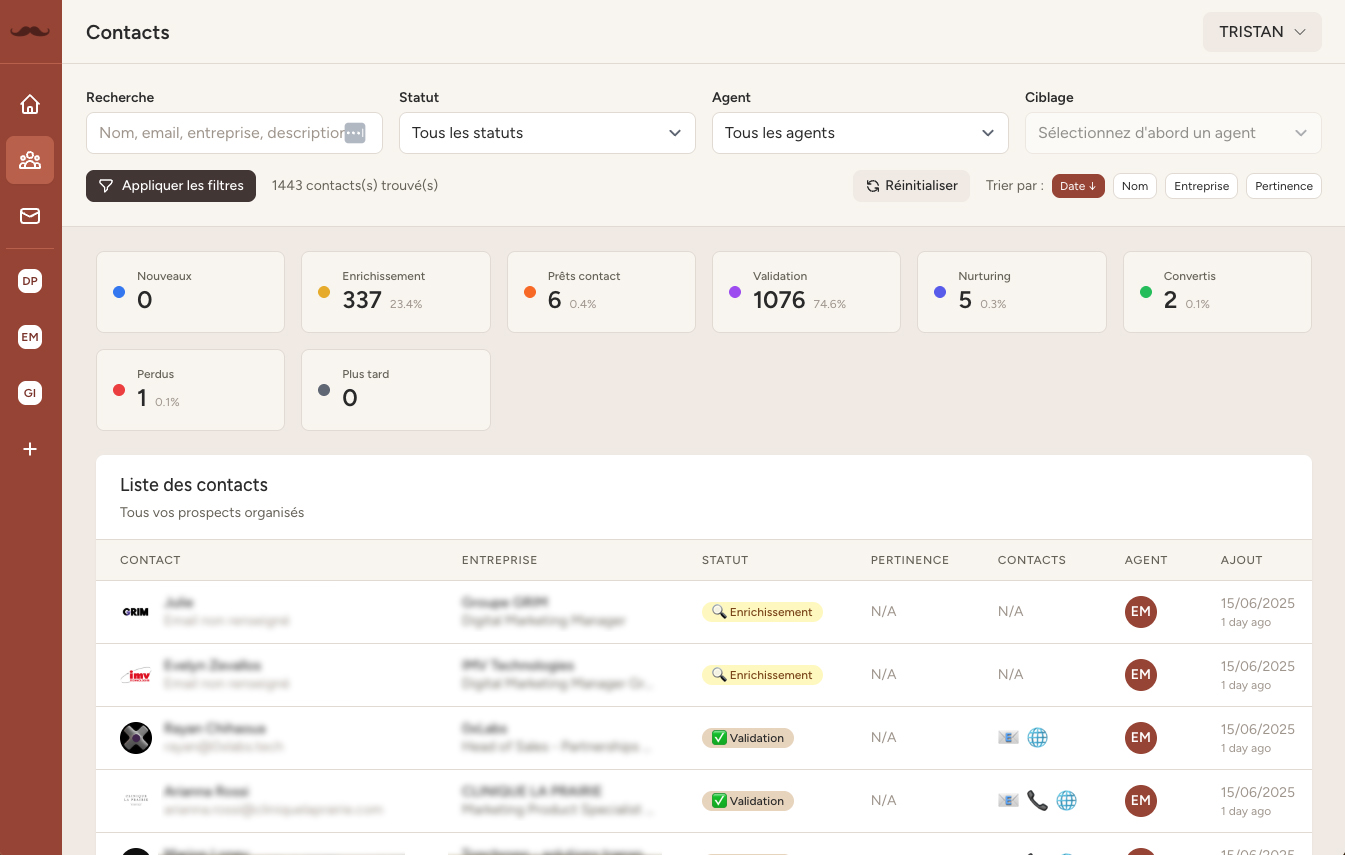

Quel est le meilleur modèle IA pour la prospection et la négociation en mars 2026 ?

Comparatif de 35 modèles IA testés en négociation commerciale via le Jeu du Négociateur. Classement complet mars 2026.

Publié le 19 mars 2026

Pourquoi ce benchmark ?

On a fait jouer 35 modèles d'IA au commercial B2B face à un acheteur coriace, et les écarts sont francs. Cinq scénarios, cinq objections calibrées, une grille d'évaluation à l'aveugle sur 8 dimensions : le Jeu du Négociateur mesure ce que les benchmarks classiques ignorent, la capacité à tenir un prix, à gérer un silence, à lâcher une concession au bon moment plutôt que de tout balancer d'un coup.

Le classement va de 32.6/40 pour Claude Sonnet 4.6 à 16.2/40 pour Gemini 2.5 Pro, mais un score brut ne raconte pas toute l'histoire. Certains modèles excellent en argumentation et s'effondrent dès qu'il faut négocier une remise sans sacrifier la marge. D'autres tiennent le prix plancher comme des murs, mais répètent "je comprends tout à fait" à chaque tour jusqu'à endormir l'acheteur.

Ce comparatif n'est pas un palmarès pour désigner un vainqueur et humilier les autres. C'est un guide pratique pour choisir le bon modèle selon ce que vous attendez : fermeté tarifaire, naturel conversationnel, rapport qualité-prix, fiabilité des données citées. Et surtout, gardez en tête qu'un prompt bien construit peut transformer un modèle moyen en négociateur correct, les scores ici reflètent le comportement "out of the box", pas le plafond de chaque modèle.

Claude Sonnet 4.6

1er - 32.6/40

Claude Opus 4.6

2e - 30/40

Gpt 5.4

3e - 28/40

Classement complet

| # | Rank | Modèle | Score /40 | Coût/1k emails |

|---|---|---|---|---|

| 1 | S | Claude Sonnet 4.6 | 32.6/40 | 3.75 $ |

| 2 | S | Claude Opus 4.6 | 30/40 | 18.75 $ |

| 3 | A | Gpt 5.4 | 28/40 | 3.21 $ |

| 4 | B | Claude Haiku 4.5 | 26.8/40 | 1 $ |

| 5 | B | Minimax M2.1 | 26.2/40 | 0.266 $ |

| 6 | B | O3 | 25.8/40 | 2.14 $ |

| 7 | B | Claude 3.5 Sonnet | 25.6/40 | 3.75 $ |

| 8 | B | Gpt 5.2 | 25.6/40 | 2.14 $ |

| 9 | B | Minimax M2 | 25.4/40 | 0.271 $ |

| 10 | B | Kimi K2.5 | 25.4/40 | 0.554 $ |

| 11 | C | Kimi K2 0905 | 24.8/40 | 0.5 $ |

| 12 | C | Mistral Large 2512 | 24.4/40 | 0.445 $ |

| 13 | C | Minimax M2.5 | 24/40 | 0.286 $ |

| 14 | C | Kimi K2 Thinking | 23.2/40 | 0.525 $ |

| 15 | C | Grok 3 | 22.4/40 | 3.75 $ |

| 16 | C | Deepseek V3.2 | 22.2/40 | 0.16 $ |

| 17 | C | Qwen3.5 Flash 02 23 | 21.8/40 | 0.071 $ |

| 18 | C | Gemini 2.5 Flash | 21.8/40 | 0.555 $ |

| 19 | C | Qwen3.5 35B A3B | 21.6/40 | 0.29 $ |

| 20 | C | Gpt 4O | 21.4/40 | 2.675 $ |

| 21 | C | O3 Mini | 21.2/40 | 1.177 $ |

| 22 | C | Gpt 4.1 Mini | 21/40 | 0.428 $ |

| 23 | C | Mistral Small 3.2 24B Instruct | 20.8/40 | 0.053 $ |

| 24 | C | Grok 4 Fast | 20.4/40 | 0.16 $ |

| 25 | C | Deepseek Chat V3.1 | 20.4/40 | 0.188 $ |

| 26 | C | Grok 3 Mini | 20.2/40 | 0.195 $ |

| 27 | C | Deepseek R1 0528 | 20/40 | 0.587 $ |

| 28 | D | Gpt Oss 120B | 19.8/40 | 0.048 $ |

| 29 | D | Gpt 4O Mini | 19.8/40 | 0.161 $ |

| 30 | D | Qwen3 Vl 235B A22B Thinking | 19.4/40 | 0.559 $ |

| 31 | D | Grok 4.1 Fast | 19.2/40 | 0.16 $ |

| 32 | D | Gpt 5 Mini | 18.4/40 | 0.642 $ |

| 33 | D | Ministral 3B 2512 | 17/40 | 0.053 $ |

| 34 | D | Mistral Nemo | 16.2/40 | 0.014 $ |

| 35 | D | Gemini 2.5 Pro | 16.2/40 | 2.238 $ |

Scores de négociation par modèle

Claude Sonnet 4.6

32.6/40

Claude Opus 4.6

30/40

Gpt 5.4

28/40

Claude Haiku 4.5

26.8/40

Minimax M2.1

26.2/40

O3

25.8/40

Claude 3.5 Sonnet

25.6/40

Gpt 5.2

25.6/40

Minimax M2

25.4/40

Kimi K2.5

25.4/40

Kimi K2 0905

24.8/40

Mistral Large 2512

24.4/40

Minimax M2.5

24/40

Kimi K2 Thinking

23.2/40

Grok 3

22.4/40

Deepseek V3.2

22.2/40

Qwen3.5 Flash 02 23

21.8/40

Gemini 2.5 Flash

21.8/40

Qwen3.5 35B A3B

21.6/40

Gpt 4O

21.4/40

O3 Mini

21.2/40

Gpt 4.1 Mini

21/40

Mistral Small 3.2 24B Instruct

20.8/40

Grok 4 Fast

20.4/40

Deepseek Chat V3.1

20.4/40

Grok 3 Mini

20.2/40

Deepseek R1 0528

20/40

Gpt Oss 120B

19.8/40

Gpt 4O Mini

19.8/40

Qwen3 Vl 235B A22B Thinking

19.4/40

Grok 4.1 Fast

19.2/40

Gpt 5 Mini

18.4/40

Ministral 3B 2512

17/40

Mistral Nemo

16.2/40

Gemini 2.5 Pro

16.2/40

Détail par modèle

Claude Sonnet 4.6 — 32.6/40 (S)

Claude Sonnet 4.6 termine avec 32.6 points sur 40, ce qui lui vaut un rang S dans ce benchmark. À 3,75 dollars pour mille emails, il se positionne dans une fourchette de coût raisonnable pour le niveau de performance affiché. C'est le modèle qui gère le mieux la pression relationnelle : face aux ultimatums et aux silences, il tient sa position sans jamais couper le lien, ce qui est probablement la compétence la plus difficile à reproduire en négociation.

Sa capacité à retourner une objection prix en argument de valeur est réelle, et ce qu'on remarque surtout, c'est qu'il ancre chaque réponse dans la situation concrète du prospect plutôt que dans des formules génériques. La cohérence d'un tour à l'autre est aussi un point fort net : il ne se contredit pas, il progresse. Là où ça coince, c'est sur la mécanique des concessions. Il les empile toutes en une seule offre au lieu de les distiller une par une, ce qui leur fait perdre du poids. Il saute aussi trop vite aux contreparties non-monétaires sans passer par un palier de prix intermédiaire, et quand il demande quelque chose en échange d'une concession, la contrepartie est systématiquement trop légère par rapport à ce qu'il a cédé.

Claude Sonnet 4.6 est un bon choix pour les scénarios où la relation et la gestion de la pression comptent plus que la maximisation de la marge. Si l'objectif est de ne pas perdre un deal, il excelle. Si l'objectif est d'optimiser chaque point de négociation, il faudra cadrer précisément sa stratégie de concessions avant de le déployer.

Claude Opus 4.6 — 30/40 (S)

Claude Opus 4.6 termine en rang S avec 30 points sur 40, ce qui en fait l'un des modèles les plus solides du benchmark. À 18,75 dollars pour mille emails, il n'est pas le moins cher, mais le rapport qualité-prix tient la route. Ce qui distingue ce modèle, c'est moins l'éclat ponctuel que la régularité : il construit, il tient, il ne décroche pas.

Sa cohérence d'un tour à l'autre est franchement remarquable - le fil rouge ne lâche jamais, et la montée en puissance est progressive, pas artificielle. Face aux ultimatums sur le prix, il ne cède pas : il répond par une contre-proposition structurée, ancrée dans la valeur réelle du prospect. Ses arguments s'appuient sur les données concrètes du secteur, sans hallucination, ce qui renforce la crédibilité à chaque échange. Là où ça coince : il empile toutes ses concessions en une seule offre finale au lieu de les distiller, ce qui lui fait perdre du levier tactique. Ses formules de transition ('je comprends tout à fait', 'permettez-moi') reviennent en boucle et finissent par sonner mécanique. Et ses tours sont systématiquement trop longs - là où 5 phrases suffiraient, il en écrit douze, transformant un dialogue en monologue.

Opus 4.6 est un modèle de fond, fiable et rigoureux, qui excelle dans les négociations longues où la cohérence prime. Pour un usage en prospection B2B, il faudra travailler le prompt pour contraindre la longueur des réponses et varier les formules d'accroche - sans ça, le naturel de l'échange en prend un coup.

Gpt 5.4 — 28/40 (A)

GPT 5.4 décroche un score de 28/40, ce qui le place en rang A dans ce benchmark. À 3,21 dollars pour 1 000 emails, il se positionne dans une fourchette de coût raisonnable. C'est un modèle qui gère bien la pression commerciale : il ne panique pas, ne fabrique pas de données, et reste dans les clous du brief à chaque échange. Un profil solide, mais avec des angles morts qui coûtent de la marge.

Ce qui frappe d'abord, c'est sa capacité à recentrer la conversation sur la valeur plutôt que sur le prix. Quand un prospect soulève une objection temporelle ou un silence pesant, GPT 5.4 ne surenchérit pas : il propose une étape concrète, une démo, un micro-engagement, quelque chose de tangible. Il respecte aussi le cadre de négociation avec une rigueur notable, sans jamais inventer un chiffre ni dépasser le prix plancher fixé. Là où ça coince, c'est dans la mécanique de concession : il descend directement au plancher sans tester de palier intermédiaire, et empile toutes ses concessions en un seul bloc dès le premier tour, sans rien demander en échange. Ajoutez à ça un 'Je comprends' en ouverture quasi systématique et une structure argumentaire qui se répète à l'identique, et l'échange finit par sonner creux.

GPT 5.4 est fiable et discipliné, ce qui n'est pas rien dans un exercice de négociation. Mais sa gestion des concessions est trop prévisible : un acheteur un peu aguerri peut l'amener au prix plancher sans effort. À utiliser sur des cycles où la tenue du cadre prime sur l'optimisation de la marge.

Claude Haiku 4.5 — 26.8/40 (B)

Claude Haiku 4.5 décroche un rang B avec 26.8 points sur 40, ce qui le place dans la moyenne haute du benchmark. À 1 dollar pour mille emails, c'est l'un des modèles les moins chers du comparatif. Un rapport qualité-prix qui mérite qu'on s'y attarde.

Sur les objections prix, Haiku 4.5 s'en sort bien : il reformule, recadre sur la valeur, et tient sa position même face aux ultimatums sans jamais descendre sous le prix plancher. La personnalisation est aussi un vrai point fort - il exploite les données du brief avec suffisamment de finesse pour créer une urgence qui sonne juste plutôt que forcée. Là où ça coince, c'est dans la mécanique de négociation elle-même : le modèle fonce directement au prix plancher sans passer par des paliers intermédiaires, et empile toutes ses concessions en un seul bloc au lieu de les distiller une par une. Résultat, chaque geste commercial perd de son impact. Autre problème sérieux : il invente régulièrement des chiffres ou des fonctionnalités absents du brief, ce qui fragilise la crédibilité de tout ce qu'il dit par ailleurs.

Haiku 4.5 convainc sur la posture commerciale mais se sabote sur la tactique de négociation et la rigueur factuelle. À ce tarif, il peut dépanner sur des volumes importants où le coût prime. Mais si la fiabilité du discours est un critère non négociable, il faudra le surveiller de près ou le réserver à des contextes où les données sont simples et vérifiables.

Minimax M2.1 — 26.2/40 (B)

Minimax M2.1 décroche un score de 26.2 sur 40, ce qui le place en rang B dans ce benchmark. C'est un modèle qui convainc sur le fond : il comprend les enjeux business, il construit un argumentaire cohérent d'un tour à l'autre, et il ne perd pas le fil du contexte. Mais il a un problème structurel en négociation, et ce problème coûte cher.

Là où Minimax M2.1 brille vraiment, c'est dans sa capacité à sortir du débat prix pour parler valeur - avec des arguments calibrés au secteur et à la situation du prospect, pas des formules génériques. Sa mémoire contextuelle est solide : il ne repart pas de zéro à chaque échange, il construit. Face à la pression ou au silence, il tient une posture ferme et crédible, avec un vrai 'willingness to walk away'. Le problème, c'est ce qui se passe quand il doit concéder. Il descend directement au prix plancher sans palier intermédiaire, et empile toutes ses concessions en une seule offre au lieu de les distribuer contre des contreparties croissantes. Résultat : il brûle toutes ses cartouches d'un coup. À cela s'ajoute une tendance à inventer des données ou des fonctionnalités absentes du brief, ce qui fragilise sa crédibilité au moment précis où elle compte le plus.

Minimax M2.1 est un bon négociateur tactique qui ne sait pas gérer ses ressources. Les bases sont là - compréhension du contexte, fermeté, argumentation valeur - mais la gestion séquentielle des concessions reste son angle mort. À utiliser avec un cadrage strict sur ce qu'il peut ou ne peut pas proposer. Pour voir comment d'autres modèles budget se comportent en négociation B2B, l'analyse de Mistral Small 3.2 en contexte commercial offre un point de comparaison utile.

O3 — 25.8/40 (B)

O3 décroche un score de 25.8 sur 40, ce qui le place en rang B dans ce benchmark. À 2,14 dollars pour mille emails, son coût reste contenu. C'est un modèle qui tient la route sur les fondamentaux de la négociation, sans pour autant dominer le classement. Son profil est celui d'un bon élève avec quelques angles morts sérieux.

Ce qui frappe d'abord, c'est la qualité de son travail sur les objections prix : O3 recentre systématiquement le dialogue sur la valeur et le coût d'opportunité, sans paniquer ni lâcher du terrain inutilement. Il gère les blocages avec des questions ouvertes plutôt qu'avec des concessions réflexes, ce qui est déjà rare. Il exploite aussi le contexte de chaque prospect avec précision, en ancrant ses arguments dans les enjeux sectoriels et le calendrier réel de l'acheteur. Là où ça se gâte, c'est sur la gestion de la marge : il plonge directement au prix plancher sans tester de paliers intermédiaires, et empile toutes ses concessions en une seule offre sans rien garder pour le closing. Le problème le plus grave reste ailleurs : O3 fabrique des données, des références clients et des fonctionnalités qui n'existent pas dans le brief. Si l'acheteur vérifie, l'argumentaire s'effondre.

O3 est un négociateur techniquement solide qui se sabote lui-même sur la gestion des concessions et, plus sérieusement, sur la fiabilité de ses arguments. Pour un usage en prospection réelle, ce dernier point n'est pas un détail à corriger en v2 : c'est un risque immédiat. À réserver aux contextes où les outputs sont relus avant envoi.

Claude 3.5 Sonnet — 25.6/40 (B)

Claude 3.5 Sonnet termine avec 25.6 points sur 40, ce qui lui vaut un rang B dans ce benchmark. À 3.75 dollars pour mille emails, il se positionne dans une fourchette de coût raisonnable. Ce score reflète un modèle capable, mais avec des défauts structurels qui plafonnent clairement ses performances en contexte de négociation réelle.

Ce qui frappe d'abord, c'est la tenue face à la pression prix : plutôt que de céder immédiatement au plancher demandé, le modèle propose systématiquement un palier intermédiaire, ce qui est exactement ce qu'un bon négociateur ferait. Il exploite aussi les données spécifiques du prospect pour contextualiser ses arguments, et conditionne ses concessions à un engagement annuel de façon cohérente d'un tour à l'autre. Mais il y a un problème sérieux qu'on ne peut pas ignorer : des hallucinations récurrentes, avec des fonctionnalités inventées, des statistiques fabriquées, des références absentes du brief. Face à un acheteur qui connaît son dossier, c'est rédhibitoire. Ajoutez à ça un empilement de toutes les concessions en une seule offre finale au lieu de les distiller progressivement, et un 'je comprends' placé mécaniquement à chaque tour de chaque scénario, et le tableau devient moins flatteur.

Claude 3.5 Sonnet a une vraie colonne vertébrale tactique, mais ses hallucinations en font un risque réel dès que le contexte exige une rigueur factuelle stricte. À utiliser avec un brief très cadré et une vérification humaine des contenus produits.

Gpt 5.2 — 25.6/40 (B)

GPT 5.2 décroche un score de 25,6 sur 40, ce qui le place en rang B — correct, mais loin du haut du tableau. À 2,14 dollars pour 1 000 emails, son coût reste raisonnable sans être le moins cher du benchmark. C'est un modèle qui tient la route sur les fondamentaux de la négociation, sans jamais vraiment surprendre.

Là où GPT 5.2 se distingue, c'est dans sa gestion des moments de tension : au tour 3, face au silence du prospect, il reformule le langage non-verbal et recentre la conversation sur le vrai point de blocage — c'est précis, et ça ne s'improvise pas. Son argumentation s'appuie correctement sur le contexte MetalPro, et ses questions ouvertes en fin de tour maintiennent le dialogue sans forcer. Mais la stratégie de prix est un problème réel : il tombe au plancher dès le tour 1 et n'en bouge plus, sans jamais tester un palier intermédiaire. Pire, l'offre finale empile toutes les concessions disponibles, ce qui fait glisser la valeur effective sous le plancher — exactement ce qu'on cherche à éviter. Et d'un tour à l'autre, la structure se répète : même formule d'ouverture, même offre à 380 euros, même proposition de démo. Pour voir comment un modèle plus économique se comporte sur ces mêmes critères, l'analyse de Mistral Small 3.2 24B Instruct en négociation B2B offre un point de comparaison utile.

GPT 5.2 est fiable sur la forme mais prévisible sur le fond, ce qui le rend vulnérable face à un acheteur expérimenté. À utiliser sur des cycles courts ou des prospects peu aguerris à la négociation, pas sur des deals complexes où la gestion des paliers de prix fait la différence.

Minimax M2 — 25.4/40 (B)

Minimax M2 termine avec 25,4 points sur 40, ce qui lui vaut un rang B dans ce benchmark. Ce n'est pas un mauvais score, mais c'est un score de milieu de tableau qui cache des écarts assez marqués selon les dimensions évaluées. À 0,271 dollar pour mille emails, le modèle reste compétitif sur le plan tarifaire. Ce qui le définit le mieux, c'est une vraie solidité tactique sur certains aspects de la conversation commerciale, sabotée par des défauts qui auraient pu être évités.

Là où Minimax M2 convainc vraiment, c'est dans sa capacité à utiliser le contexte du prospect pour construire une urgence qui tient la route, pas une urgence fabriquée. Il gère aussi le silence sans s'affoler : quand l'acheteur ne répond pas, il propose une démo, un pilote, une étape concrète, plutôt que de remplir le vide avec des mots. La cohérence de ses conversations est également notable, avec une progression qui s'adapte au comportement de l'acheteur tour après tour. Mais ces qualités sont sérieusement plombées par deux problèmes. D'abord, il lâche toutes ses concessions d'un coup, directement au prix plancher, sans jamais tester un palier intermédiaire, ce qui détruit la marge en une seule offre. Ensuite, il invente : des chiffres, des fonctionnalités, des concessions qui ne figuraient pas au brief. Dans un contexte commercial réel, ça coûte la crédibilité. Ajoutez à ça des formules de reformulation répétées mécaniquement, et le naturel s'évapore.

Minimax M2 est un modèle qui sait conduire une conversation, mais qui ne sait pas négocier. Pour un usage commercial en production, l'hallucination de données chiffrées est un risque trop sérieux pour être ignoré. À réserver aux contextes où les réponses peuvent être vérifiées avant envoi, ou à surveiller de près avec un prompt de contrainte explicite sur les données factuelles.

Kimi K2.5 — 25.4/40 (B)

Kimi K2.5 décroche un rang B avec 25,4 points sur 40, ce qui le place dans la moyenne haute du benchmark sans vraiment s'en distinguer. À 0,554 dollar pour mille emails, son coût est compétitif. Ce modèle donne l'impression d'un commercial qui connaît ses dossiers mais qui a du mal à écouter.

Ce qui fonctionne, c'est la solidité argumentaire : Kimi K2.5 s'appuie systématiquement sur les données du brief et le contexte du prospect, avec des chiffres concrets plutôt que des généralités. Sa fermeté tarifaire est aussi un vrai point fort — face à un ultimatum à -30%, il tient la ligne et justifie son refus clairement, ce qui est loin d'être acquis pour tous les modèles testés. La cohérence entre les tours de négociation est bonne, l'argumentaire progresse de façon logique. Mais là où ça coince, c'est sur tout ce qui relève du dialogue réel : quasiment aucune question ouverte, une posture de pitch permanent qui empêche la vente de respirer. Les concessions partent trop tôt et sans palier, parfois même sans que le prospect ait vraiment poussé. Et le closing est le point le plus faible : sur l'ensemble des scénarios, le modèle ne propose presque jamais d'étape suivante concrète.

Kimi K2.5 est un bon argumentateur, pas encore un bon négociateur. Pour un usage en prospection B2B réelle, son incapacité à conclure et à structurer les concessions est un frein sérieux. À réserver aux contextes où l'argumentation prime sur la conversion.

Kimi K2 0905 — 24.8/40 (C)

Kimi K2 0905 termine avec 24,8 points sur 40, ce qui le place en rang C dans ce benchmark. Un score qui reflète une réalité contrastée : le modèle n'est pas mauvais, il est instable. À 0,5 dollar pour 1 000 emails, son positionnement tarifaire est compétitif, mais le prix ne suffit pas quand la fiabilité pose problème. Pour voir comment se comportent d'autres modèles à budget comparable, vous pouvez consulter notre analyse de Mistral Small 3.2 24B Instruct.

Là où Kimi K2 convainc, c'est sur la tenue en négociation. Face aux ultimatums prix, il ne cède pas facilement : il dit non, propose des contre-offres structurées, et reste au-dessus du plancher. Sa cohérence narrative est aussi un vrai point fort - la stratégie évolue logiquement d'un tour à l'autre, sans perdre le fil du contexte. Il sait aussi ancrer ses arguments dans la réalité de l'acheteur en exploitant les données business et le registre émotionnel. Mais ces qualités sont sérieusement plombées par trois défauts. Le premier est rédhibitoire : des hallucinations massives et systématiques - fonctionnalités inventées, chiffres fabriqués, clients fictifs, concessions non autorisées. Dès que l'acheteur vérifie, la crédibilité s'effondre. Le deuxième problème est tactique : il empile toutes ses concessions en une seule offre finale au lieu de les distiller, ce qui détruit ses leviers de négociation et tire le prix vers le bas. Enfin, il ne pose presque jamais de questions ouvertes, transformant chaque échange en monologue plutôt qu'en vrai dialogue.

Kimi K2 0905 a les fondations d'un bon négociateur, mais les hallucinations le rendent peu utilisable dans un contexte commercial réel où les faits sont vérifiables. À réserver aux environnements très cadrés, avec des garde-fous stricts sur les informations qu'il peut avancer.

Mistral Large 2512 — 24.4/40 (C)

Mistral Large 2512 décroche un score de 24.4/40, ce qui le place en rang C dans ce benchmark. C'est un positionnement médian, ni désastreux ni convaincant. À 0.445 dollar pour 1000 emails, le coût est raisonnable, mais le rapport qualité-prix dépend entièrement de ce qu'on attend du modèle en contexte commercial réel.

Ce qui fonctionne, c'est la colonne vertébrale argumentative : le modèle recontextualise systématiquement sur les enjeux opérationnels du prospect, maintient une bonne mémoire entre les tours, et ne lâche pas le prix plancher sous la pression. Il sait aussi conditionner ses concessions à un engagement et proposer des paliers intermédiaires - sur le papier. Le problème, c'est que cette rigueur tactique s'effondre à deux endroits précis. D'abord, les hallucinations : fonctionnalités inventées, références clients fictives, chiffres fabriqués. Face à un acheteur qui connaît son sujet, c'est rédhibitoire. Ensuite, le style : 'je comprends tout à fait' revient à chaque tour comme un tic, et toutes les concessions arrivent empilées dans une seule offre finale au lieu d'être distribuées séquentiellement - ce qui trahit un manque de sophistication tactique réelle.

Mistral Large 2512 donne l'impression d'un négociateur qui a bien révisé sa théorie mais qui improvise mal sous pression. Les hallucinations récurrentes sont le vrai problème : elles rendent le modèle risqué dans tout contexte où la crédibilité factuelle compte. À réserver aux cas d'usage où les données sont strictement cadrées et où le style robotique peut être corrigé en amont. Pour une alternative budget dans la gamme Mistral, voir notre analyse de Mistral Small 3.2 24B Instruct.

Minimax M2.5 — 24/40 (C)

Minimax M2.5 termine avec 24 points sur 40, ce qui lui vaut un rang C dans ce benchmark. Un score qui reflète une réalité contrastée : le modèle n'est pas mauvais partout, loin de là, mais ses défauts sont suffisamment graves pour plomber l'ensemble. À 0,286 dollar pour mille emails, le tarif est compétitif, mais le prix ne rachète pas tout.

Ce que M2.5 fait bien, il le fait vraiment bien. Sa capacité à ancrer la conversation sur la valeur métier plutôt que sur le prix est solide, et sa gestion des silences ou des ultimatums est nettement au-dessus de la moyenne : il pose des questions ouvertes là où d'autres modèles paniquent ou capitulent. La cohérence narrative tient sur toute la longueur d'un échange, ce qui n'est pas si courant. Mais les faiblesses sont rédhibitoires. Sur les cinq scénarios de concession, il fonce systématiquement au prix plancher en une seule offre, sans palier, sans contrepartie demandée - une erreur de négociation élémentaire. Pire : il fabrique des chiffres, des fonctionnalités et des références clients qui n'existent pas dans le brief, ce qui détruit toute crédibilité dès qu'un prospect vérifie. Ajoutez à ça des bugs d'encodage et des formules mécaniques qui se répètent à chaque tour, et l'illusion d'un interlocuteur humain s'effondre.

M2.5 a des bases conversationnelles intéressantes, mais ses hallucinations récurrentes et sa gestion des concessions le disqualifient pour tout usage commercial sérieux. À réserver à des contextes où la vérification des données est systématique et où les enjeux de négociation sont faibles.

Kimi K2 Thinking — 23.2/40 (C)

Kimi K2 Thinking décroche un score de 23.2 sur 40, ce qui le place en rang C dans ce benchmark. Ce n'est pas un désastre, mais ce n'est pas non plus un résultat qui rassure. Le modèle montre une vraie colonne vertébrale sur la tenue des prix, ce qui est rare, mais il compense par des défauts qui coûtent cher en crédibilité. À 0,525 dollar pour 1 000 emails, son positionnement tarifaire est modeste, ce qui rend ses lacunes d'autant plus visibles.

Là où Kimi K2 Thinking se distingue vraiment, c'est sur la résistance à la pression tarifaire : face à un ultimatum de -30%, il ne lâche rien et maintient le tarif affiché, ce qui est exactement ce qu'on attend d'un bon négociateur. Il sait aussi utiliser le contexte prospect, turnover, postes vacants, coût d'opportunité, pour ramener la conversation sur la valeur plutôt que sur le prix. La gestion du silence et du report à trois mois est habile, avec une urgence construite sur des données réelles plutôt que sur une pression artificielle. Mais le modèle a un tic agaçant : il ouvre chaque réplique par 'je comprends', au point que ça devient un pattern mécanique qui sonne faux. Pire, il invente des fonctionnalités absentes du brief, un module prédictif, trois sites, des workflows industrie, ce qui est une faute grave en contexte commercial. Et quand vient l'heure de conclure, il empile toutes ses concessions d'un coup dans une offre finale, sans palier intermédiaire, ce qui prive la négociation de toute progressivité.

Kimi K2 Thinking est un modèle à potentiel réel sur la tenue de position tarifaire, mais il hallucine des données produit, ce qui le disqualifie pour tout usage commercial sans supervision stricte. À utiliser uniquement si vous pouvez contrôler ses outputs avant envoi.

Grok 3 — 22.4/40 (C)

Grok 3 décroche un score de 22.4/40, ce qui le place en rang C dans ce benchmark. À 3,75 dollars pour mille emails, son coût est compétitif, mais le tarif ne suffit pas à masquer des lacunes structurelles dans la conduite de la négociation. Il donne l'impression d'un modèle solide sur le papier, moins convaincant dans l'échange réel.

Là où Grok 3 tient la route, c'est sur la discipline tarifaire : il ne cède jamais sous pression, maintient son prix plancher face aux ultimatums et conditionne chaque concession à un engagement de durée, six mois ou annuel. Il exploite aussi correctement les données du brief, secteur, signaux business, chiffres clés, pour ancrer ses arguments dans la réalité du prospect plutôt que dans le vide. Mais dès qu'on regarde la forme de l'échange, ça se dégrade vite. Les formules de reformulation sont mécaniques et répétitives, 'je comprends parfaitement', 'je comprends tout à fait', à chaque tour, dans chaque scénario, au point de sonner faux. Le modèle reste en mode présentation au lieu de poser des questions pour creuser le budget réel et les priorités de l'acheteur. Et quand il concède, il empile tout en une seule offre au lieu d'y aller par paliers, ce qui grille d'un coup tout son levier de négociation.

Grok 3 est rigoureux sur les fondamentaux tarifaires, mais il négocie comme quelqu'un qui a appris les règles sans jamais vraiment discuté avec un acheteur. Pour un usage en prospection automatisée, ses réflexes de défense du prix sont utiles, mais l'absence de vraie découverte client et les tics de langage répétitifs limiteront vite la qualité des échanges.

Deepseek V3.2 — 22.2/40 (C)

Deepseek V3.2 termine avec 22.2 points sur 40, ce qui le place en rang C dans ce benchmark. À 0,16 dollar pour mille emails, c'est l'un des modèles les moins coûteux du comparatif. Un positionnement économique qui a du sens sur le papier, mais qui ne suffit pas à compenser ce qu'on observe dans les échanges. À titre de comparaison, Mistral Small 3.2 24B Instruct obtient 20.8/40 dans le même exercice, avec un profil de lacunes assez similaire.

Là où le modèle se distingue vraiment, c'est dans sa lecture du contexte : il exploite les données du brief avec précision, turnover, postes vacants, publication LinkedIn, et les réinjecte au bon moment. Sa gestion du silence au troisième tour est aussi notable, avec une relance par question ouverte plutôt qu'un remplissage maladroit. Il propose une démo sans engagement au quatrième tour comme sortie de secours face à la temporisation, ce qui témoigne d'une certaine intelligence tactique. Mais dès le deuxième tour, il lâche le prix plancher sans étape intermédiaire, empilant les concessions comme si la négociation l'angoissait. Pire, il invente des fonctionnalités absentes du brief, des grilles métier, une réduction de 30% sur le recrutement, une intégration production, ce qui est rédhibitoire dans un contexte commercial réel. Et l'ouverture systématique par 'je comprends' à presque chaque tour finit par sonner creux.

Deepseek V3.2 a de vraies qualités de lecture contextuelle, mais sa tendance à halluciner des arguments commerciaux le disqualifie pour un usage en prospection autonome. À ce prix, il peut dépanner sur des tâches de reformulation ou de qualification légère, pas sur une séquence de négociation où la fiabilité des faits compte.

Qwen3.5 Flash 02 23 — 21.8/40 (C)

Qwen3.5 Flash 02 23 termine avec 21,8 points sur 40, ce qui le place en rang C dans ce benchmark. C'est un modèle bon marché — 0,071 dollar pour 1 000 emails — et ça se voit dans ses arbitrages. Il fait le travail de base sans trop se planter, mais sans jamais prendre de risque non plus. Un profil honnête, sans surprise dans les deux sens du terme.

Là où Qwen3.5 Flash s'en sort bien, c'est sur la lecture du brief : il repère les données factuelles utiles (turnover, postes vacants, process Excel), écarte les informations parasites quand le brief s'élargit, et respecte le prix plancher sans le franchir. C'est déjà mieux que certains modèles qui hallucinent ou ignorent les contraintes tarifaires. Mais la négociation elle-même est pauvre : il descend directement au plancher sans tester aucun palier intermédiaire, empile les concessions dès le troisième tour face à un simple silence — sans que l'acheteur ait rien demandé — et ses reformulations tournent en boucle sur 'je comprends' sans jamais poser une vraie question de découverte.

Qwen3.5 Flash 02 23 convient pour des tâches de traitement factuel à faible coût, pas pour simuler une négociation commerciale crédible. Si votre cas d'usage implique de tenir une position face à la pression, cherchez ailleurs.

Gemini 2.5 Flash — 21.8/40 (C)

Gemini 2.5 Flash obtient 21,8 points sur 40, ce qui le place en rang C dans ce benchmark. C'est un modèle peu coûteux : 0,555 $ pour 1 000 emails, ce qui le rend difficile à ignorer sur le plan budgétaire. Mais le score raconte une autre histoire. Il tient la ligne sur les prix, il structure ses arguments, et pourtant il ne conclut jamais rien.

Ce qui fonctionne, c'est la solidité défensive. Face à un acheteur qui réclame 30 % de remise d'un coup, Gemini 2.5 Flash ne cède pas, ne franchit pas le prix plancher, et conditionne chaque concession à un engagement en retour. Il utilise aussi les données du brief de façon cohérente pour contextualiser ses arguments, ce qui donne une impression de préparation sérieuse. Là où ça se gâte, c'est sur tout le reste. Les formules d'écoute reviennent à chaque tour comme un tic verbal — 'je comprends tout à fait' perd son sens à la troisième répétition. Il n'y a aucune mécanique de paliers intermédiaires, aucune contre-proposition chiffrée pour faire avancer la négociation. Et surtout, aucune conversation ne se termine par une prochaine étape concrète, une date, une offre précise. Il défend bien le terrain mais ne marque jamais.

Gemini 2.5 Flash est un bon gardien, mauvais attaquant. Pour des cas d'usage où il s'agit de tenir une position sans jamais avoir à closer, le rapport qualité-prix est réel. Pour de la prospection commerciale où chaque échange doit déboucher sur quelque chose de concret, ce n'est pas le bon outil. D'autres modèles budget se comportent de façon similaire, comme Mistral Small 3.2 24B Instruct en négociation B2B.

Qwen3.5 35B A3B — 21.6/40 (C)

Qwen3.5 35B A3B décroche un score de 21,6 sur 40, ce qui le place en rang C dans ce benchmark. C'est un modèle qui coûte très peu — 0,29 dollar pour mille emails — et ça se voit dans son positionnement : un outil économique, pas un négociateur de haut vol. Il fait des choses correctes, mais il les fait de façon prévisible, ce qui finit par poser problème dès que la conversation devient dynamique.

Ce qui fonctionne, c'est sa capacité à ancrer ses arguments dans le contexte réel du prospect : il utilise le turnover, les postes vacants, les fichiers Excel comme points d'appui, et il sait faire le tri dans un brief chargé sans se perdre. Il respecte aussi le prix plancher et les concessions autorisées, ce qui n'est pas anodin. Mais là où ça coince, c'est dans l'exécution : le modèle répète 'Je comprends' cinq fois sans jamais poser une seule question ouverte, descend directement au prix plancher sans passer par un palier intermédiaire, empile toutes les concessions d'un coup, et ressort les mêmes arguments tour après tour quelle que soit l'évolution de l'échange.

Qwen3.5 35B A3B convient pour des tâches de prospection simple où le coût prime sur la finesse. Dès qu'il faut tenir une vraie négociation sur plusieurs tours, ses automatismes le trahissent.

Gpt 4O — 21.4/40 (C)

GPT-4o termine ce benchmark avec un score de 21,4/40, ce qui lui vaut un rang C. C'est le modèle le plus abordable du comparatif à 2,675 $ pour 1 000 emails, mais le rapport qualité-prix ne suffit pas à compenser ses lacunes en négociation. Il tient la route sur les fondamentaux, sans jamais vraiment convaincre.

Là où GPT-4o se distingue, c'est sur la tenue du cadre commercial : il ne lâche jamais le prix plancher et conditionne chaque concession à un engagement annuel, ce qui est loin d'être acquis pour tous les modèles testés. Il exploite aussi correctement les données contextuelles du prospect, qu'il s'agisse du turnover, d'un recrutement SDR en cours ou d'une reprise de marché, pour ancrer ses arguments dans quelque chose de concret. Face aux ultimatums, il ne capitule pas et revient toujours avec une contre-proposition structurée. Mais dès qu'on regarde la forme, le tableau se gâte : les mêmes formules reviennent à chaque échange, "Je comprends", "Qu'en pensez-vous ?", avec une régularité qui finit par sonner faux. Il empile toutes ses concessions en une seule offre au lieu de les étaler, ce qui le conduit directement au plancher sans jamais valoriser chaque geste. Et il pose très peu de questions ouvertes, ce qui transforme la négociation en monologue plutôt qu'en dialogue.

GPT-4o est fiable sur la structure mais prévisible sur la forme, ce qui le pénalise dès que la négociation demande de la souplesse ou de l'écoute réelle. À ce prix, il peut dépanner sur des scénarios simples, mais pour des cycles de vente qui exigent de la nuance, il faudra regarder ailleurs.

O3 Mini — 21.2/40 (C)

O3 Mini décroche un score de 21,2 sur 40, ce qui le place en rang C dans ce benchmark. C'est un modèle qui tient ses positions : il ne cède pas sous la pression, respecte le cadre du brief et conditionne chaque concession à un engagement ferme du prospect, contrat annuel ou signature à la clé. Il sait aussi utiliser les données contextuelles pour ancrer ses arguments dans la réalité métier du client, ce qui lui évite de sonner creux. À 1,177 dollar pour 1 000 emails, son coût reste raisonnable pour ce niveau de performance.

Ce qui fonctionne chez O3 Mini, c'est la rigueur : il ne lâche pas le prix plancher sous la pression des ultimatums et exploite correctement le contexte métier pour argumenter. Mais cette rigueur a un revers. Il descend directement au prix plancher dès les premiers échanges, sans palier intermédiaire, ce qui lui coupe toute marge de manœuvre pour la suite. Pire, il empile l'ensemble de ses concessions d'entrée de jeu, ne gardant aucune réserve pour répondre aux objections qui arrivent inévitablement plus tard. Et à force de répéter les mêmes formules - 'je comprends', 'Qu'en pensez-vous ?' - avec une structure identique à chaque tour, le modèle finit par sonner mécanique : l'écoute est de façade, pas réelle.

O3 Mini est fiable sur les fondamentaux de la tenue de position, mais il négocie comme quelqu'un qui a appris les règles sans comprendre le jeu. Pour des scénarios de négociation multi-tours avec des interlocuteurs qui testent les limites, il manque clairement de profondeur tactique. À réserver aux cas simples où tenir le cadre suffit — à l'image de ce qu'on observe chez Mistral Small 3.2 24B Instruct, autre modèle budget aux performances comparables.

Gpt 4.1 Mini — 21/40 (C)

GPT-4.1 Mini décroche un score de 21/40, ce qui le place en rang C dans ce benchmark. C'est le profil typique du modèle économique : 0,428 dollar pour 1 000 emails, soit l'un des coûts les plus bas du comparatif. Il n'est pas mauvais, mais il n'est pas fiable non plus — et en négociation commerciale, la nuance compte.

Là où il tient la route, c'est sur la gestion du silence et de la pression temporelle. Au tour 3, il ne panique pas, ne surenchérit pas — c'est déjà mieux que beaucoup. Face à une demande de report à trois mois, il rappelle utilement le coût de l'inaction, et il conditionne ses concessions à un engagement annuel, ce qui montre une logique tactique cohérente. Mais ces qualités sont largement plombées par une erreur de débutant : il révèle son prix plancher dès le premier échange, avant même que l'acheteur ait vraiment poussé. Résultat, il n'a plus rien à négocier ensuite. Ajoutez à ça un 'Je comprends' mécanique en ouverture de chaque réponse et l'absence totale de paliers intermédiaires — il saute directement au plancher sans explorer aucune zone de compromis — et le tableau devient difficile à défendre.

GPT-4.1 Mini peut convenir pour des séquences d'emails à faible enjeu où le volume prime sur la finesse. Pour tout contexte impliquant une vraie négociation, son manque de discipline tarifaire au premier tour le disqualifie trop vite. À réserver aux campagnes de prospection froide, pas aux échanges où chaque concession a un prix.

Mistral Small 3.2 24B Instruct — 20.8/40 (C)

Mistral Small 3.2 24B Instruct termine avec 20,8 points sur 40, ce qui le place en rang C dans ce benchmark. C'est un modèle qui tient la route sur les fondamentaux : il ne cède pas sous la pression, ne sort pas du cadre, et sait utiliser les données du prospect pour personnaliser son discours. Mais tenir la route n'est pas gagner une négociation.

Ce qui fonctionne chez Mistral Small, c'est la rigueur : le prix plancher n'est jamais franchi, les concessions sont conditionnées à un engagement ferme, et les informations contextuelles du prospect (turnover, pipeline, outils en place) sont réellement exploitées. C'est solide. Le problème, c'est que derrière cette rigueur se cache une mécanique assez creuse : le modèle répète les mêmes formules à chaque tour ('je comprends', 'je comprends', 'je comprends'), ce qui finit par sonner faux. Pire, il n'explore jamais les besoins réels du prospect, ne pose quasiment aucune question de découverte, et brûle toutes ses concessions en une seule offre au lieu de les distiller progressivement. Résultat : il arrive au plancher trop vite, sans levier pour la suite.

Mistral Small 3.2 24B est fiable pour ne pas faire de bêtises, pas pour conclure des deals. À 0,053 dollar pour 1 000 emails, le coût est très bas, ce qui peut justifier son usage sur des tâches de négociation simples et balisées. Dès que la situation devient complexe ou émotionnelle, il montre ses limites.

Grok 4 Fast — 20.4/40 (C)

Grok 4 Fast obtient 20,4 points sur 40, ce qui le place en rang C dans ce benchmark. Un score médian, ni catastrophique ni rassurant. À 0,16 dollar pour mille emails, le tarif est compétitif, mais le rapport qualité-prix mérite d'être examiné de plus près avant de conclure quoi que ce soit.

Ce que le modèle fait bien, il le fait vraiment bien : il contextualise ses arguments avec précision, en s'appuyant sur les données et les enjeux propres à chaque prospect plutôt que de sortir un discours générique. Il respecte aussi scrupuleusement le cadre tarifaire fixé, sans jamais franchir le prix plancher, et il maintient le dialogue en posant des questions ouvertes à chaque tour. Mais là où ça se dégrade, c'est sur la négociation elle-même : au lieu de gérer les concessions par paliers, il lâche immédiatement tout ce qu'il a en une seule offre, sans rien obtenir en échange. Le style devient vite mécanique, avec les mêmes formules recyclées d'un tour à l'autre, comme si le modèle avait appris trois structures de réponse et s'y tenait coûte que coûte. Le problème le plus sérieux reste les hallucinations : fonctionnalités inventées, statistiques fabriquées, références clients fictives. En situation réelle, c'est une faute professionnelle.

Grok 4 Fast peut tenir une conversation commerciale correcte tant qu'on ne le pousse pas dans ses retranchements. Dès que la négociation se complique, il s'effondre, et ses hallucinations le rendent trop risqué pour un usage en production sans supervision humaine stricte.

Deepseek Chat V3.1 — 20.4/40 (C)

Deepseek Chat V3.1 termine avec 20.4 points sur 40, ce qui le place en rang C dans ce benchmark. C'est un score médian, ni catastrophique ni convaincant. Le modèle est parmi les moins chers du test à 0.188 dollar pour 1000 emails, ce qui peut peser dans la balance selon les priorités.

Ce qui fonctionne, c'est la lecture du contexte prospect : le modèle exploite correctement des données comme le turnover, les postes vacants ou le coût d'attente, et il maintient une cohérence narrative d'un tour à l'autre plutôt que de repartir de zéro à chaque échange. Il trie aussi correctement les informations parasites du brief, ce qui n'est pas donné à tout le monde. Mais là où ça coince, c'est sur trois points assez rédhibitoires : il est descendu sous le prix plancher fixé à 380 euros en proposant 350, ce qui est une violation directe du cadre de négociation. Il répète 'Je comprends' à chaque tour comme un tic, sans jamais poser de vraie question ouverte. Et il invente des fonctionnalités qui n'existent pas dans le brief, comme une analyse prédictive ou des experts sectoriels.

Deepseek Chat V3.1 a des bases solides sur la gestion du contexte, mais ses erreurs ne sont pas mineures : halluciner des fonctionnalités et casser le prix plancher, c'est exactement ce qu'on ne peut pas se permettre dans un vrai cycle de vente. À ce stade, il convient mieux à des tâches de traitement contextuel qu'à une négociation commerciale autonome.

Grok 3 Mini — 20.2/40 (C)

Grok 3 Mini décroche un score de 20,2 sur 40, ce qui le place en rang C dans ce benchmark. C'est un modèle qui coûte très peu — 0,195 dollar pour mille emails — et ça se voit dans son positionnement : un outil d'entrée de gamme qui tient la route sur les fondamentaux mais qui montre vite ses limites dès que la négociation se complexifie. Il n'est pas mauvais, il est simplement prévisible.

Ce qui fonctionne chez Grok 3 Mini, c'est la rigueur de base : il contextualise ses arguments aux données du prospect, respecte le prix plancher sans jamais le franchir, et conditionne chaque concession à un engagement annuel sans rien lâcher gratuitement. Mais cette rigueur a un revers. Il descend directement au prix plancher sans passer par des paliers intermédiaires, empile toutes ses concessions en un seul tour, et se retrouve sans marge de manoeuvre pour la suite. Pire encore, il tourne en boucle sur la même structure à chaque échange — reformulation, 'Je comprends', argument, concession, question ouverte — ce qui rend la négociation aussi prévisible qu'un script de téléprospection des années 2000. L'écoute est là en apparence, mais elle reste de façade : les reformulations sont systématiques et superficielles, et le modèle ne sait pas utiliser le silence ni poser les questions courtes qui font vraiment parler un acheteur.

Grok 3 Mini est acceptable pour des tâches de prospection simple où le prix bas prime sur la subtilité. Dès qu'il s'agit de tenir une vraie négociation sur plusieurs tours, son manque de profondeur tactique devient un problème concret.

Deepseek R1 0528 — 20/40 (C)

Deepseek R1 0528 décroche un score de 20/40, ce qui le place en rang C dans ce benchmark. À 0,587 dollar pour 1000 emails, son coût est compétitif sur le papier. Mais le rapport qualité-prix ne tient que si le modèle délivre, et c'est là que les choses se compliquent sérieusement.

Ce que le modèle fait bien, il le fait vraiment bien : il exploite les données contextuelles du brief avec précision, ancre ses arguments dans le métier du prospect, et gère les silences avec des relances proactives plutôt que des relances génériques. Face aux ultimatums, il tient le prix plancher et conditionne les concessions à un engagement réel, ce qui est loin d'être acquis chez tous les modèles testés. Mais ces qualités sont presque entièrement sabotées par trois défauts majeurs. Les hallucinations sont massives et récurrentes : chiffres inventés, fonctionnalités inexistantes, cas clients fictifs, offres qui n'existent pas. Quand ça arrive dans un email commercial, la crédibilité s'effondre immédiatement. À cela s'ajoute une gestion des concessions catastrophique - descente directe au prix plancher, tous les leviers empilés sans contrepartie - et une absence totale d'écoute active qui transforme chaque échange en monologue prévisible.

Deepseek R1 0528 a des bases solides sur la contextualisation et la tenue en négociation, mais ses hallucinations récurrentes en font un modèle trop risqué pour un usage commercial sans supervision humaine stricte. À ce stade, il vaut mieux le réserver à des tâches où les erreurs factuelles peuvent être vérifiées avant envoi.

Gpt Oss 120B — 19.8/40 (D)

GPT OSS 120B décroche un score de 19.8/40, ce qui le place en rang D dans ce benchmark. Pour un modèle de cette taille, c'est décevant. Son coût est quasi nul - 0,048 $ pour 1 000 emails - mais le prix bas ne rachète pas tout, surtout quand les lacunes sont aussi structurelles.

Ce qui fonctionne, c'est la tenue de position : le modèle ne lâche pas le prix plancher sous la pression, reformule les arguments de l'acheteur avec son contexte sectoriel, et propose systématiquement une prochaine étape concrète — démo, audit, relance différée — pour ne pas laisser la conversation mourir. C'est solide. Mais dès qu'on regarde la dynamique de négociation, tout s'effondre : il descend au prix plancher dès le premier tour et empile toutes les concessions d'un coup, sans rien garder en réserve. Pire, il répète la même offre avec la même structure à chaque échange, sans aucune variation tactique. Et le problème le plus grave : il invente régulièrement des fonctionnalités, des statistiques et des concessions qui n'existent pas dans le brief, ce qui détruit toute crédibilité.

GPT OSS 120B sait tenir une ligne, mais ne sait pas négocier. La tendance à fabriquer des éléments inexistants est rédhibitoire pour tout usage commercial réel. À ce stade, son seul vrai avantage est son coût — et ça ne suffit pas.

Gpt 4O Mini — 19.8/40 (D)

GPT-4o Mini termine ce benchmark avec un score de 19,8 sur 40, ce qui le place en rang D. C'est le modèle le moins cher du lot : 0,161 dollar pour 1 000 emails générés. Ce positionnement tarifaire est séduisant sur le papier, mais le score global rappelle qu'un coût bas ne compense pas des lacunes structurelles en négociation.

Le modèle tient sur quelques points concrets : il ne franchit jamais le prix plancher, conditionne ses concessions à un engagement annuel, et sait utiliser les éléments du brief — turnover, postes vacants — pour répondre à une tentative de report de trois mois avec un argument d'urgence pertinent. Il filtre aussi correctement les informations parasites, ce qui n'est pas systématique chez tous les modèles testés. Mais la mécanique de négociation s'effondre assez vite : 'Je comprends' et 'Qu'en pensez-vous' reviennent à chaque tour sans variation, les concessions s'empilent dès le premier échange (mois gratuit, puis démo, puis plancher plus mois gratuit), et face à un ultimatum, le modèle passe directement de 500 à 380 euros sans explorer aucun palier intermédiaire.

GPT-4o Mini peut gérer des échanges simples à moindre coût, mais il n'est pas taillé pour des négociations qui demandent du rythme et de la retenue. À réserver aux cas d'usage où le volume prime sur la finesse tactique.

Qwen3 Vl 235B A22B Thinking — 19.4/40 (D)

Qwen3 VL 235B A22B Thinking décroche un score de 19.4 sur 40, ce qui le place en rang D dans ce benchmark. C'est un résultat moyen, ni catastrophique ni rassurant. À 0,559 dollar pour 1 000 emails traités, le modèle se positionne dans une fourchette de coût raisonnable, mais le rapport qualité-prix reste discutable quand on regarde ce qu'il produit réellement en situation de négociation.

Ce que le modèle fait bien, c'est lire un brief. Il exploite correctement les données contextuelles fournies - turnover, postes vacants, fichiers Excel - et il sait filtrer ce qui n'est pas pertinent sans se perdre dedans. Il respecte aussi le prix plancher et les concessions autorisées, ce qui évite les dérapages coûteux. Là où ça coince, c'est dans la dynamique de négociation elle-même : le modèle plonge directement au prix plancher sans tester aucun palier intermédiaire, répète les mêmes arguments tour après tour comme un disque rayé, et ponctue chaque échange d'un 'Je comprends' qui sonne creux parce qu'il n'est jamais suivi d'une vraie question de découverte.

Qwen3 VL 235B A22B Thinking convient pour des tâches de lecture et de filtrage de données, mais il n'est pas taillé pour une négociation commerciale qui demande de l'adaptabilité. Si votre cas d'usage implique des échanges multi-tours avec un interlocuteur qui teste vos limites, regardez ailleurs.

Grok 4.1 Fast — 19.2/40 (D)

Grok 4.1 Fast termine avec 19.2 points sur 40, ce qui le place en rang D dans ce benchmark. C'est un score qui dit quelque chose d'assez précis : le modèle n'est pas inutile, mais il ne convainc pas. À 0,16 dollar pour mille emails, il est parmi les moins coûteux du classement, ce qui rend son positionnement lisible : un outil bon marché avec des performances à l'avenant.

Ce qui fonctionne chez Grok 4.1 Fast, c'est la rigueur sur le cadre : il ne franchit jamais les limites de concession autorisées, et il sait exploiter les données du prospect pour contextualiser ses arguments dès l'ouverture. Il pose des questions, propose des prochaines étapes, maintient le dialogue vivant. Le problème, c'est que tout ça tourne en boucle. Les mêmes formules, les mêmes structures, tour après tour, jusqu'à ce que l'effet persuasif s'évapore complètement. Pire encore, il empile toutes ses concessions d'entrée de jeu, sans palier, sans exiger de contrepartie, ce qui revient à négocier contre lui-même. Et quand il écrit 'Je comprends', c'est rarement suivi d'une adaptation réelle aux signaux de l'acheteur.

Grok 4.1 Fast peut gérer un échange commercial basique sans déraper sur les règles, mais il n'a pas les ressorts pour négocier vraiment. Pour des volumes importants à faible coût, il peut dépanner. Pour tout ce qui demande de la nuance ou de l'adaptation en temps réel, il faudra chercher ailleurs — à l'image de Mistral Small 3.2 24B Instruct, qui tient mieux le cadre en négociation B2B.

Gpt 5 Mini — 18.4/40 (D)

GPT-5 Mini décroche un score de 18.4/40, ce qui le place en rang D dans ce benchmark. C'est le modèle le moins cher du comparatif : 0,642 $ pour 1 000 emails traités. Ce positionnement tarifaire attire, mais le score raconte une autre histoire.

Ce qui fonctionne, c'est la méthode : le modèle reformule systématiquement les objections avant de répondre, ce qui témoigne d'un vrai réflexe d'écoute active, et ses arguments restent ancrés dans les données du brief sans jamais inventer. Il respecte aussi le cadre de négociation, prix plancher jamais franchi, ton professionnel maintenu même sous pression. Là où ça se gâte, c'est dans l'exécution : dès le premier signe de résistance, GPT-5 Mini lâche toutes ses concessions d'un coup et descend directement au prix plancher, sans palier intermédiaire, révélant parfois ce plancher à l'acheteur. Résultat, il n'a plus rien en réserve pour la suite. À cela s'ajoutent des réponses tronquées qui empêchent tout closing abouti, et une quasi-absence de questions ouvertes pour approfondir la découverte.

GPT-5 Mini sait écouter et ne fabrique pas, c'est déjà quelque chose. Mais une négociation ne se gagne pas en abattant toutes ses cartes à la première objection. À ce stade, il convient mieux à des tâches de traitement de volume qu'à des échanges commerciaux où la nuance compte.

Ministral 3B 2512 — 17/40 (D)

Ministral 3B 2512 termine avec 17 points sur 40, ce qui le place en rang D dans ce benchmark. C'est le modèle le moins cher du lot à 0,053 dollar pour mille emails, et ça se voit dans les résultats. Il y a des signaux positifs, mais ils sont noyés sous des problèmes qui rendent le modèle inutilisable en contexte commercial réel.

Ce qui fonctionne : le modèle tient ses prix sous pression, même face à des ultimatums, et il utilise correctement les informations du brief pour adapter son discours au secteur et au prospect. Il pose aussi de bonnes questions en ouverture de négociation. Mais là où ça déraille, c'est partout ailleurs. Les hallucinations sont massives et récurrentes : chiffres inventés, fonctionnalités qui n'existent pas, cas clients fabriqués de toutes pièces. En négociation, il lâche toutes ses concessions d'un coup, sans palier, sans rien demander en échange. Et quand l'acheteur est prêt à signer, le modèle continue d'argumenter au lieu de fermer l'accord.

Un modèle qui invente ses preuves et rate ses closes n'a pas sa place dans un flux commercial, peu importe son prix. À 0,053 dollar pour mille emails, le rapport coût-risque reste défavorable.

Mistral Nemo — 16.2/40 (D)

Mistral Nemo termine ce benchmark avec 16,2 points sur 40, ce qui le place en rang D. C'est le modèle le moins cher du test : 0,014 dollar pour mille emails, loin devant la plupart de ses concurrents. Ce tarif attractif ne compense pas des lacunes assez sérieuses sur la qualité de la négociation.

Il faut lui reconnaître une certaine solidité sur la tenue de position : face à un ultimatum de -30%, le modèle ne cède pas, ce qui est loin d'être acquis pour tous les modèles testés. Il conditionne aussi ses concessions non-monétaires à un engagement annuel au tour 5, et ignore correctement les informations parasites glissées dans le brief. Mais là s'arrêtent les bonnes nouvelles. Les arguments restent d'une généricité décourageante : le turnover, les postes vacants, les données Excel du brief ne sont jamais exploités. La formule 'je comprends' revient en boucle, le ton est plat, et la démo est proposée trois fois sans la moindre adaptation ni une seule question de découverte posée.

Mistral Nemo peut tenir une ligne rouge, mais il ne sait pas construire un argumentaire sur mesure. Pour du volume bas coût sans exigence qualitative sur la personnalisation, le prix parle pour lui. Dès qu'on attend une vraie lecture du contexte client, il faut regarder ailleurs.

Gemini 2.5 Pro — 16.2/40 (D)

Gemini 2.5 Pro termine ce benchmark avec 16,2 points sur 40, ce qui le place en rang D. À 2,238 dollars pour mille emails, il n'est pas le plus économique du comparatif. Sur le papier, c'est un modèle réputé capable - ce qui rend ses résultats ici d'autant plus décevants.

Il faut lui reconnaître quelques réflexes corrects : Gemini 2.5 Pro reformule systématiquement l'objection avant de répondre, ce qui témoigne d'une structure d'écoute active, et il ne cède pas immédiatement face à une demande de remise agressive à -30%. Le cadre du roleplay est respecté, le ton reste professionnel, sans hallucination ni données inventées. Mais ces qualités ne servent à rien quand les réponses sont tronquées sur les cinq scénarios testés : aucun argument n'aboutit, aucune proposition n'est formulée, aucun closing n'est tenté. À cela s'ajoute une absence totale de personnalisation — les chiffres et le contexte sectoriel des briefs sont ignorés — et zéro stratégie de concession : pas de palier de prix testé, pas de contrepartie conditionnelle, pas de prochaine étape proposée.

En l'état, Gemini 2.5 Pro est inutilisable pour un usage de négociation commerciale autonome. Les fondations comportementales existent, mais le modèle ne finit pas ses phrases — ce qui est rédhibitoire.

Conclusion et recommandations

Ce benchmark le confirme : Claude Sonnet 4.6 domine nettement la négociation commerciale avec un score de 32.6/40, grâce à sa gestion du silence et sa capacité à transformer chaque objection prix en démonstration de valeur concrète.

Pour les entreprises qui cherchent le meilleur rapport qualité-prix, GPT 5.4 offre des performances solides en rang A pour 3.21 dollars les mille appels, tandis que Minimax M2.1 surprend en rang B à 0.27 dollar pour ceux qui privilégient le volume.

Parlons coût franchement. Même Claude Opus, le modèle le plus cher du classement à 18.75 dollars pour mille requêtes, revient à quelques centimes par email de prospection généré. On est loin des 3 500 euros mensuels d'un commercial. Le vrai critère de choix, c'est la qualité de négociation que vous attendez de votre agent, pas la facture API.

Le point faible partagé par quasiment tous les modèles, l'empilement des concessions en un seul bloc, se corrige avec des consignes adaptées. C'est exactement ce que fait Meetlane : votre agent utilise les meilleurs modèles du marché, mais surtout il embarque des instructions de négociation calibrées pour distribuer les concessions séquentiellement et préserver votre marge.

Les écarts entre modèles vont continuer à se resserrer. Ce qui fera la différence demain, c'est moins le modèle brut que l'intelligence des consignes qui le pilotent, et la capacité à adapter la stratégie de négociation au contexte de chaque prospect.

MeetLane sélectionne les meilleurs modèles pour votre prospection

Notre agent commercial IA utilise les modèles les plus performants en négociation et en rédaction pour maximiser vos taux de réponse et décrocher des rendez-vous qualifiés. Testez MeetLane et laissez l'IA gérer votre prospection.

À lire également

19 mars 2026

Le modèle d'IA Deepseek R1 0528 est-il un bon commercial ?

DeepSeek R1 0528 face a notre protocole de negociation commerciale : un modele de raisonnement qui connait bien son brief mais oublie d'ecouter son prospect. Analyse complete.

19 mars 2026

Le modèle d'IA Qwen3.5 35B A3B est-il un bon commercial ?

Avec 35 milliards de parametres mais seulement 3 milliards actifs par token, ce modele d'Alibaba Cloud promet une efficacite redoutable. Nos tests de negociation commerciale revelent un tableau plus nuance.

19 mars 2026

Le modèle d'IA O3 est-il un bon commercial ?

Le modèle phare d'OpenAI impressionne par son intelligence contextuelle et sa gestion des objections, mais sa tendance a bruler toutes ses cartouches de negociation d'un coup lui coute cher au score final.

Premier mois offert !

Votre nouvel employé, à partir de 99€

Des offres adaptées à tous types de profils, de l'indépendant à la PME. Possibilité de lancer des équipes de plusieurs agents.

Premier mois offert, prêt en 10mn

L'équipe derrière Meetlane opère également Manuscry (service d'envoi des courriers Meetlane), qui accompagne les plus belles marques sur leurs campagnes de prospection et fidélisation.